作者:哔哔News

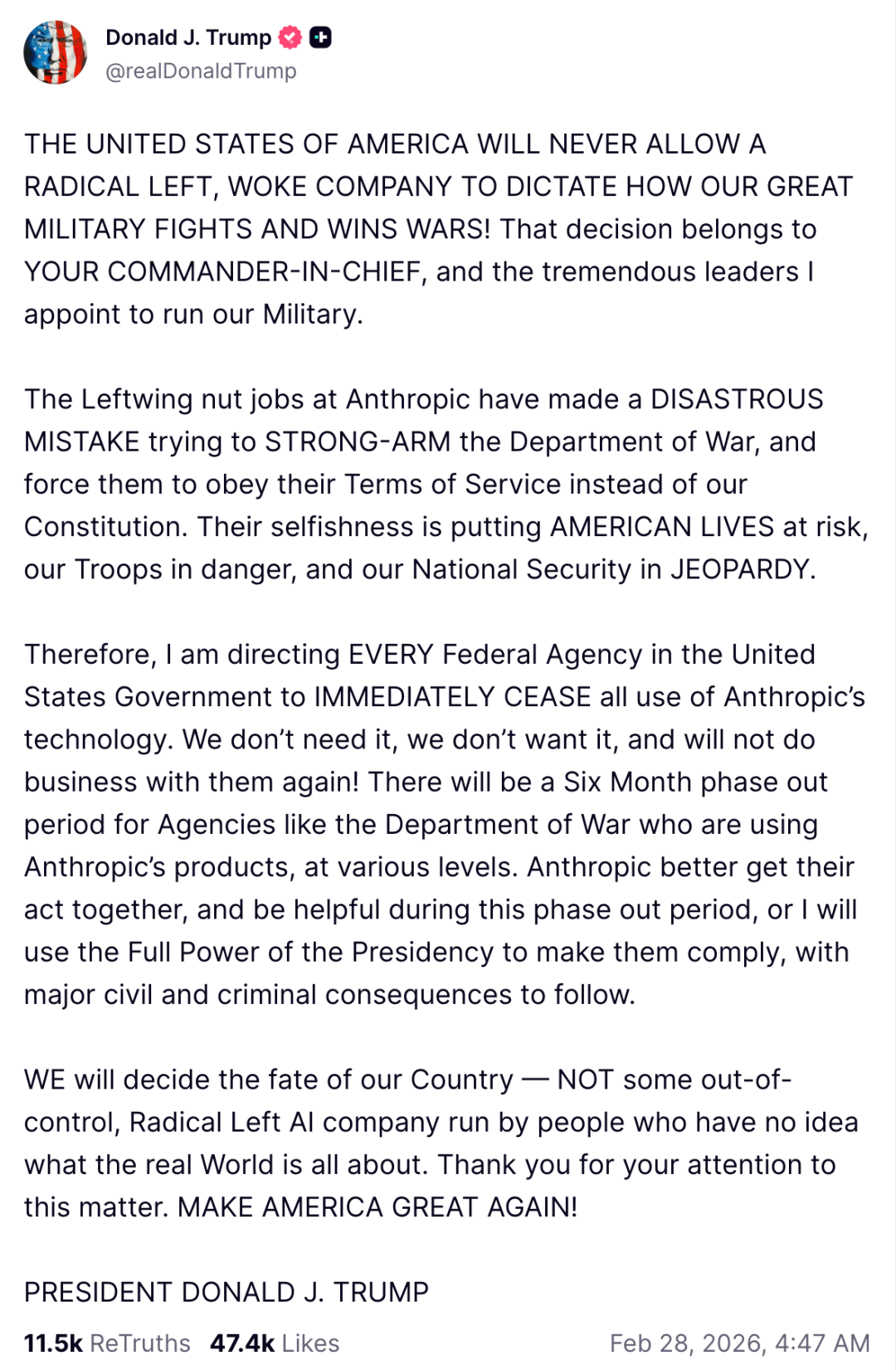

美国时间 2026年2月27日傍晚,特朗普在个人社交平台 TruthSocial 上的帖子如同政治炸弹般引爆了美国政府与科技界的对峙:宣布“所有联邦机构立即停止使用 Anthropic 的所有 AI 技术”,并给出 六个月过渡期。

他扬言,倘若政府部门不执行,将动用“总统全部权力,包括重大民事和刑事后果”。同时多次称 Anthropic 为“激进左翼、觉醒公司”,并指控其试图让五角大楼遵守服务条款而非宪法,同时以口号“MAKE AMERICA GREAT AGAIN!”收尾。

随即,国防部长Pete Hegseth在X平台跟进宣布,将Anthropic指定为“国家安全供应链风险企业”,并禁止任何军方承包商与其开展业务,此前这一标签几乎只用于华为等外国实体。

Anthropic 绝不妥协的两条红线

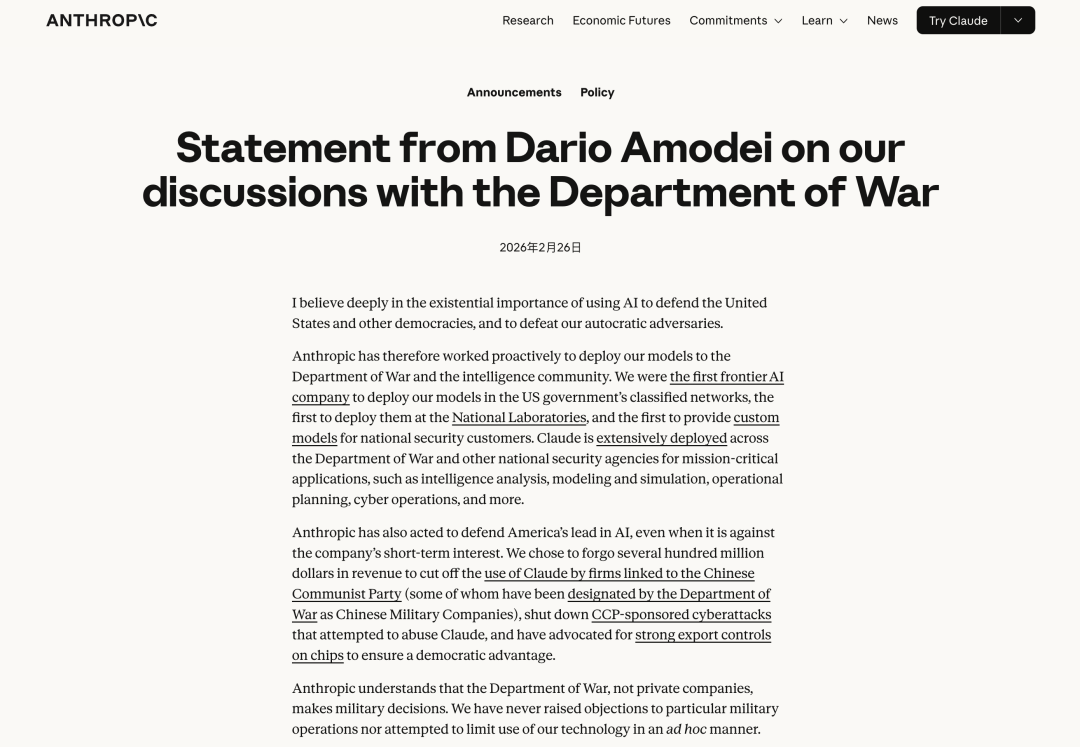

作为此次事件的核心当事方,Anthropic 在 2月26–27 日之间的回应逻辑清晰且具有伦理分量。公司 CEO Dario Amodei 不止一次地公开强调,他们愿意与政府合作,但无法也不会在“原则良知”上妥协。

Amodei 的声明中最核心的一句话是:“我们不能在良知上同意(cannot in good conscience accede)。”

这并非情绪化辞令,而是基于公司的长远价值观和对技术安全性的严谨评估。他指出,尽管Claude Gov 已被部署到机密网络、用于情报分析、作战模拟以及网络防御等敏感任务,但当前 前沿AI 的可靠性尚不足以承担某些特定用途的风险。他特别强调:

将 AI 用于大规模国内监控美国公民可能侵蚀基本自由;

将 AI 用于无需人类监督的完全自主致命武器更可能危及士兵与平民的生命安全。

Anthropic并非“反军方”。相反,它是首批主动切断与中国军方关联企业合作、打击中共赞助网络攻击、并支持对华芯片出口管制的AI公司。公司许诺将继续推进技术研发与安全合作,但绝不放弃这两条核心红线。

特朗普帖文发布后,Anthropic 进一步发布官方声明,强调“积极支持合法国防用途”,承诺全力配合六个月过渡,同时宣布将对“供应链风险”认定提起法律挑战,称此举“前所未有、法律上站不住脚,并为所有与政府合作的美国科技企业设立危险先例”。

安全对齐优先的核心理念

Anthropic 由前 OpenAI核心成员 Dario Amodei 与 Daniela Amodei 兄妹及另外数位研究人员于 2021 年共同创立。公司自成立之初便明确将“安全且与人类价值观对齐”作为核心使命,而非单纯追求模型规模或商业化速度。

短短几年内,Anthropic完成多轮大型融资,累计约300亿美元,2025年估值已达约3800亿美元,正筹备IPO,成为全球最受关注的AI企业之一。其声誉主要源于在安全性与企业级可靠性上的领先。

Anthropic 的核心技术理念被称为 “Constitutional AI”(宪法AI)。这一方法通过预设一套明确原则体系,使模型在推理与决策过程中主动遵循行为边界,从源头减少不可预测或失控输出。

基于这一理念开发的 Claude 系列模型,以极低幻觉率、强可解释性和严格安全护栏著称,围绕helpful(有用)、harmless(无害)、honest(诚实)三原则展开,在企业级与政府敏感场景中被公认为“最可靠、最不爱胡说八道的AI”。

与OpenAI的GPT系列、Google的Gemini或xAI的Grok相比,Anthropic的差异在于发展优先级,安全对齐优先于速度竞赛。正因如此,Claude Gov才成为首批获准部署进入美国机密军事网络的前沿AI模型之一。

与五角大楼合作的突然转折

在宣布停用前,Anthropic 并非政府体系中的边缘技术供应商,而是已经与美国政府建立了实质合作关系的供应商。

2025年7月签署的近2亿美元合同,使Claude Gov成为首个进入美军机密网络的前沿AI模型,被广泛用于情报合成、战术战略规划模拟、网络安全防御及机密档案处理。一线官员曾将其称为“显著提升决策效率、国家安全的重要助力者”。

合作初期,双方关系建立在较高程度的互信基础之上。Anthropic 主动配合美国政府的技术与安全政策,包括支持对华先进芯片出口限制,并终止所有可能涉及中国军方关联的业务往来。五角大楼曾公开称赞其为“最先进且最安全的合作伙伴”。

然而,在五角大楼希望修改合同条款之时,军方要求将 ClaudeGov 的权限开放到“所有合法用途”(any lawful use),包括大规模国内监控美国公民以及无需人类监督的完全自主杀伤系统时,这一立场转变几乎在 24 小时内完成。

对军方而言,这是提升作战灵活性和技术能力的策略调整,但对 Anthropic 来说,则触碰了其从未妥协的核心红线。

特朗普的权威施压

2月27日下午,Anthropic CEO Dario Amodei 公布公开拒绝五角大楼最后通牒的声明后,不到一小时,特朗普便在 Truth Social 发布强硬帖文,明确命令全美联邦机构停用 Anthropic 的技术。

他将公司贴上“激进左翼、觉醒公司”的标签,兑现特朗普 2.0 任期开局打击“觉醒硅谷”的承诺,并巩固保守派政治基础,同时强调总统作为总司令的绝对权威。此举迅速将原本技术与合同争议上升为政治与意识形态冲突,也显示出政府在 AI 军事应用中对控制与顺从的高度关注。

战略上,事件产生了明显威慑效应。OpenAI 在特朗普发帖数小时后立即宣布与国防部达成新协议,保留与 Anthropic 完全相同的两条红线,禁止大规模国内监控美国公民、以及确保人类对致命武力使用负责,却迅速获批。

这在行业中传递出潜在规则:在与政府合作中,服从姿态往往比坚持原则更易获得机会,也让其他AI 公司更倾向妥协,避免成为“下一个 Anthropic”。

这一事件延续了美国对科技企业监管的趋势,从 TikTok、华为的限制,到如今针对本土“觉醒”企业的施压,并首次将“供应链风险”标签用于美国公司,标志着政府与 AI 巨头的关系正在重塑为“服从为先,否则边缘化”的新格局。

坚守原则还是妥协合作?

各方对这场冲突的反应呈现出明显分化,也折射出技术、政治与伦理的复杂交织。

Anthropic 方面态度强硬。公司宣布将就“供应链风险”的认定提起法律挑战,CEO Dario Amodei 在内部与公开沟通中将此次事件形容为一次“原则层面的胜利”,强调公司不会突破既定安全边界。据多家媒体披露,公司员工内部也广泛流传“良知底线不能被打破”的共识。

科技界对此普遍表达支持,多位 AI 科学家、风险投资人以及 OpenAI 和 Google 员工公开声援 Anthropic 的原则,强调前沿 AI 系统必须置于“有意义的人类控制”之下。Max Tegmark 甚至呼吁整个行业联合,确保前沿 AI 不被用于夺取生命的场景。

五角大楼副部长 Emil Michael 称,对 Anthropic 的要求“简单且合理”,目的是防止 AI 危及关键军事行动。国防部长 Hegseth 则直接将 Anthropic 列为“国家安全供应链风险”,强调“战士绝不会被大科技公司的意识形态奇想挟持”。

民主党参议员 Mark Warner 指出,特朗普的决策可能更多出于政治考量而非审慎分析;四位国防政策参议员也致信敦促双方冷静,警告“将此变为非此即彼的时刻可能损害国家安全及技术产业与华盛顿的合作意愿”。

AI时代的政府压力与道德考验

Anthropic短期虽失去部分政府合同,但占比有限,其象征意义却极为重大。公司合作伙伴信心、估值及IPO前景均可能因此承压。与此同时,OpenAI、xAI/Grok等更愿意配合的竞争对手迅速受益,快速填补军方合同空缺,进一步提升市场影响力和估值。

从长期来看,这场冲突可能加速AI企业“去政府化”趋势,并推动行业明显分化为“亲军方派”与“原则派”,从而重塑整个AI产业格局。在技术层面,事件凸显了AI军事化进程中安全护栏与作战灵活性之间仍存在尖锐矛盾。

退役空军将军Jack Shanahan指出,当前AI模型远未准备好应用于完全自主武器或高度敏感的国防任务,这场争议也有望推动全球AI治理讨论:红线究竟应由企业设定,还是由政府决定?

这一事件的核心,是权威、意识形态与技术伦理之间的激烈碰撞。Anthropic坚守其“Constitutional AI”原则与安全红线,而特朗普政府则强调总统与总司令的绝对权威,将Anthropic贴上“左翼、觉醒”标签并施以强硬压力。

未来6个月过渡期将成为关键观察窗口:Anthropic能否通过法律或谈判逆转局面,或将直接影响整个AI行业与政府的未来合作模式。

No Comments