作者:Wall Street CN

昨日微软一口气发布三款自研AI模型:MAI-Transcribe-1、MAI-Voice-1和MAI-Image-2,分别覆盖语音转写、语音生成与图像生成三大高频应用场景。

有外媒评论,此举标志着微软正在自建AI技术体系,以降低对OpenAI的依赖。

官方博客显示,MAI-Transcribe-1批量转录速度是现有Microsoft Azure Fast产品的2.5倍,在FLEURS基准测试中平均词错误率最低;MAI-Voice-1则可在仅需1秒即可生成60秒的音频;MAI-Image-2的图像生成速度至少提升了2倍。

在我们的实测中,三款模型表现各异:MAI-Transcribe-1在一倍速下转写准确,但二倍速播放《无间道》天台对峙片段时,将“我也读过警校,你们这些卧底真有意思”误识为“我也读过剑桥,你们学会计真有意思”;面对《寒战》中节奏更快、情绪更激烈的争吵片段,甚至出现完全无响应的“宕机”现象。

MAI-Voice-1则能生成风格迥异的语音:英式版本低沉有韵律,呈现莎士比亚式舞台感;美式版本轻快明亮,细节甚至包括人说话时的口水声,逼真感强。MAI-Image-2在官方示例中自然景观渲染表现在线,但在实测中面对复杂指令时仍有局限。

语音转录实测:中文结果无标点,把二倍速无间道对峙转成“剑桥会计”

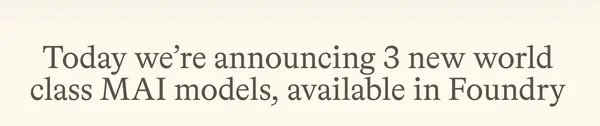

MAI-Transcribe-1是语音转文本模型,微软称其在FLEURS基准测试中,针对微软产品使用率最高的25种语言,实现了最低的平均词错误率。

此外,微软还称该模型在这些语言中的表现优于OpenAI的 Whisper-large-v3,并在其余大多数基准测试语言中胜过谷歌的Gemini 3.1 Flash。微软表示,其批量转录速度较现有的Azure产品有了显著提升。通过Foundry平台进行转录的起价为每小时0.36美元。

实测中,我们选取了电影《无间道》中刘德华与梁朝伟天台对峙的经典桥段,分别以一倍速与二倍速输入MAI-Transcribe-1。

▲电影《无间道》天台对峙名场面

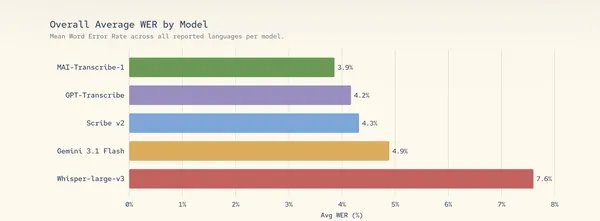

一倍速播放测试环节,这款工具的表现算得上中规中矩:整段天台对白的文字转录零误差,但美中不足的是,输出文本完全没有标点断句,读起来更像一长串毫无停顿的文字流,少了原片里的对话节奏感。

▲MAI-Transcribe-1正常速度语音转录结果

换句话说,它已经具备“听得准”的能力,但至少对于中文普通话来说,距离“直接可用”的字幕级体验,仍需要依赖后期人工整理来补足。

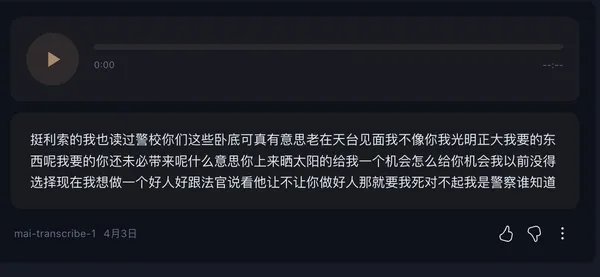

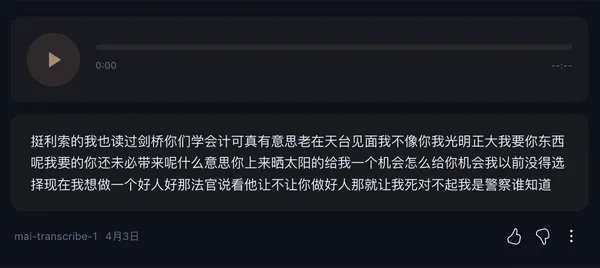

紧接着,当我们把播放速度调到二倍速,戏剧性的一幕出现了。

▲MAI-Transcribe-1二倍速语音转录结果

原句里的“我也读过警校,你们这些卧底真有意思”,居然被“魔改”成了“我也读过剑桥,你们学会计真有意思”。

“警校”变“剑桥”,“卧底”成“会计”,语义发生整体偏移,甚至重构了场景语境。

最后,我们进一步加码测试,播放了电影《寒战》中节奏更快、情绪更激烈的经典争执片段。结果是,MAI-Transcribe-1几乎“当场宕机”,未能给出有效转录输出,稳定性出现明显下降。

▲MAI-Transcribe-1寒战吵架名场面转录结果

一轮测试下来不难看出,MAI-Transcribe-1在常规语速下的转录准确性基本在线,但面对倍速播放、激烈争吵这类复杂语音场景,短板就暴露无遗了。尤其是在发音相近词汇的精准区分、语速加快后的语义连贯性判断,以及强情绪语音的识别适配等方面,都还有不小的优化空间。

语音生成实测:能模拟出说话时的口水声

根据微软官方博客信息,MAI-Voice-1是一款高效语音生成模型,可在单块GPU上于1秒内生成1分钟音频。该模型能够在长篇内容中保持说话人的身份。微软通过Foundry平台以每百万字符22美元的价格出售该技术。

鉴于目前只支持英语,实测环节中,我们选取了莎士比亚的经典诗歌Sonnet 18(十四行诗第18首)作为测试文本,输入至MAI-Voice-1,并分别生成“莎士比亚风格的英式口音版本”与“喜悦语气的美式口音版本”,以观察其在情绪建模与语音细节控制上的差异。

从结果来看,两种风格呈现出较为明显的分化。莎士比亚式的英音版本整体语速更缓,音频时长明显变长,音色趋于低沉,在句间与词间插入了更多停顿与换气声,形成类似舞台朗诵的节奏感。MAI-Voice-1对停顿、重音的调度,使得语音具备一定的情绪张力,接近人类在朗诵时的自然状态。

相比之下,喜悦语气的美音版本则更偏向轻快与流动,语速提升,语调上扬,整体听感更为明亮。在细节层面,可以感受到类似“口水声”等生理性噪音,这类细节一方面说明模型在尝试模拟更真实的发声环境,包括口腔湿润度、气流摩擦等微观特征。

图片生成:能体现空间纵深感

MAI-Image-2现已通过Foundry平台与其他两款模型一同面向大众市场。在Arena.ai的文本转图像排行榜上,它位列第三,仅次于谷歌的Nano Banana 2和OpenAI的GPT-Image 1.5。

微软将其定价为:文本输入每百万个token 5美元,图像输出每百万个token 33美元。该公司已开始在Copilot、Bing Image Creator和PowerPoint等产品中推广该模型。全球最大的广告公司之一WPP是首批大规模使用该模型的企业合作伙伴之一。

▲MAI-Image-2官方生成效果(官方指令为“画面呈现出逼真的电影级风景:一条狭窄的山脊蜿蜒穿过深邃的峡谷,两侧耸立着垂直的岩壁,上面覆盖着郁郁葱葱的苔藓和柔软的植被。一条狭窄的土路沿着山脊蜿蜒而上,通往山顶,两个身材矮小的徒步者背对着镜头,凸显了峡谷的辽阔和孤寂。浓厚的雾气弥漫在峡谷中,营造出层次感和柔和的渐变效果,漫射的阴天光线柔和自然,没有生硬的阴影。湿润的苔藓、微妙的水汽和有机物的表面纹理极其细腻,色彩以深绿色和大地色调为主,呈现出柔和的自然色调。采用略微抬高的长焦镜头拍摄,压缩了景深,构图极具戏剧性,营造出一种广袤无垠和静谧孤寂之感,具有国家地理的风格,8K分辨率,浅雾,以及立体雾气效果。画面比例为1:1。”)

从官方样片中可以看出,苔藓、岩壁的纹理清晰,雾气与光影的层次过渡自然,色彩表现也柔和协调,没有传统文生图模型的“过饱和”或“扭曲”通病。在长焦视角和景深处理上,模型能复刻真实摄影的空间感,具有纵深感。

不过在实际测试中我们也发现,该模型对指令复杂度的兼容度有限。面对结构简单、元素单一的生成需求时表现稳定,但一旦输入包含多元素、多场景的复杂指令,系统便会直接提示无法生成。

▲MAI-Image-2简单指令下生成效果(指令为“独自一人在浩瀚的宇宙中,周围只有偶尔漂浮而过的微小尘埃,强调人最大限度的孤独感,画面整体呈柔和的冷色调,有电影质感。”)

▲MAI-Image-2复杂指令下生成效果(指令为“在浩瀚无垠、一览无余的外太空中央,瑞恩·高斯林身着一套精致的星空主题宇航服,在完全失重的状态下缓缓漂浮。他的身体轻轻旋转,四肢自然伸展,仿佛被宇宙温柔地环抱着。头盔的面罩反射着星光和远处闪烁的光芒,他的表情平静而又带着一丝沉思。周围空无一物——没有建筑物,没有干扰——只有偶尔漂浮的粒子和细小的宇宙尘埃,增强了太空的真实感和静谧的运动感。构图强调了人类极致的孤独感,将科幻美学与电影光影完美融合。整体风格明亮而超写实,画面流畅如胶片,光线柔和而冷峻。”)

结语:微软想要降低对OpenAI的依赖?

MAI-Transcribe-1、MAI-Voice-1和MAI-Image-2这三个模型现已可通过 Microsoft Foundry和MAI Playground获取。这是微软首次面向商业用户提供跨多种模态的自研模型,三款模型均由Mustafa Suleyman领导的微软人工智能超级智能团队自主研发。

微软同时仍保留了与OpenAI直至2032年的深度合约访问权限。Foundry平台通过同一API提供对OpenAI的GPT模型、Anthropic的Claude模型以及微软自家MAI系列模型的访问。

微软多年来一直是OpenAI技术的分销合作伙伴。如今,它正致力自建多种AI模型的竞争能力,同时托管OpenAI的模型、Anthropic的模型以及不断增长的开源替代方案库。

对于正在评估AI自研战略的高管们来说,问题不再是微软是否依赖OpenAI,而是微软能否以多快的速度用自有模型缩小性能差距,以及内部研发的经济效益是否足以支撑这项投资。

本文来源:

No Comments