Author:BitEq

2026年3月18日(北京时间凌晨),OpenAI正式推出了GPT-5.4mini和GPT-5.4nano两款小型模型。官方称这是公司"迄今为止能力最强的小型模型",专为高吞吐量、低延迟的工作负载而设计。

说实话,这次发布让人感到意外。OpenAI刚刚在本月初推出了完整的GPT-5.4,这么快就放出mini和nano版本,节奏确实比往年快了不少。看来AI行业的竞争已经进入白热化阶段。

GPT-5.4mini:小身材,大能量

GPT-5.4mini的表现确实让人印象深刻。在SWE-BenchPro软件工程基准测试中,它拿下了54.4%的分数,而上一代GPT-5mini只有45.7%。更关键的是,它已经接近完整版GPT-5.4(57.7%)的水平。

另一个值得关注的指标是计算机使用能力。在OSWorld-Verified测试中,GPT-5.4mini得分72.1%,几乎是GPT-5mini(42.0%)的两倍,距离GPT-5.4(75.0%)只差不到3%。

速度方面,OpenAI官方数据称比GPT-5mini快2倍以上。对于需要实时响应的应用场景,这个提升很有价值。

GPT-5.4nano:极致轻量化的选择

如果说mini是"小钢炮",那nano就是"轻骑兵"。它的定位很明确:分类、数据提取、排序这类轻量任务。

在AIQL查询生成测试中,nano的表现甚至超过了GPT-5.1、GPT-4.1这些更大的模型,接近GPT-5.2的水平。而且它比GPT-5nano快4倍以上,指令跟随能力也有明显提升。

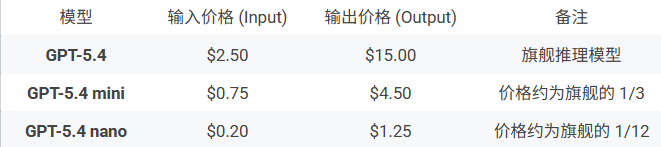

定价大幅上涨

这次发布最引人争议的可能是定价。两款新模型的价格比上一代都有大幅上涨:

每百万Token

对比上一代,GPT-5.4mini的输入价格是GPT-5mini的3倍,输出价格是2.25倍;GPT-5.4nano的输入价格是GPT-5nano的4倍,输出价格是3.125倍

涨价幅度确实不小。但换个角度看,与完整版GPT-5.4相比,mini和nano依然便宜得多。而且考虑到性能的大幅提升,实际性价比可能反而更高。

应用场景

简单来说,就是让大模型(如GPT-5.4)负责规划和决策,小模型(mini/nano)并行处理具体的子任务。例如,在代码审查场景中,GPT-5.4可以制定审查策略,然后让多个mini实例分别处理代码搜索、文件审查、测试用例生成等任务。

根据OpenAI Codex平台的数据,这种架构能把成本降到单独使用GPT-5.4的约30%。这种模式其实挺聪明的。它利用了不同规模模型的各自优势,既保证了整体质量,又控制了成本。

GPT-5.4mini能根据屏幕截图理解界面并执行操作。这个能力在自动化办公、UI测试、RPA(机器人流程自动化)等场景很有用。

GPT-5.4nano的定位很明确:实时对话、内容转写、数据打标签、快速问答。这些场景对延迟和成本都很敏感,nano的"极致轻量化"设计正好对症下药。

结语

这次发布的时间点很有意思。就在不久前,Anthropic的Claude Code因为能从头创建应用程序而在开发者圈子里火了一把。OpenAI显然不想让出AI软件工程这块阵地。GPT-5.4mini和nano的推出,某种程度上是对Anthropic的正面回应。GPT-5.4mini和nano的发布,代表了OpenAI在小模型领域的重要突破。它们不仅性能大幅提升,而且在成本控制和响应速度方面都有明显优势。

免责声明:请读者严格遵守所在地法律法规,本文内容基于市场公开资料整理仅供参考,不构成任何投资建议。

No Comments